Umgang mit ChatGPT und Co.

Auf künstlicher Intelligenz basierende Sprachmodelle wie ChatGPT finden immer weitere Verbreitung. Welche grundlegenden Dinge sollte man wissen, worauf muss man bei der Benutzung achten und wie kann man solche Tools zielführend benutzen?

Wir haben Ihnen auf dieser Seite einige Informationen mit Antworten auf diese Fragen zusammengestellt. Informieren Sie sich über

Hinweise zum Umgang mit KI-basierten Sprachmodellanwendungen in der Lehre

KI-basierte Sprachmodelle wie z. B. ChatGPT verwenden maschinelles Lernen und künstliche Intelligenz, um Texte zu generieren. Dazu werden Wortwahrscheinlichkeiten berechnet, um z. B. Antworten auf Fragen zu erstellen.

Diese Systeme bieten große Chancen. Es gibt jedoch auch Risiken und Zusammenhänge, deren man sich bei der Nutzung bewusst sein sollte. Die folgenden Abschnitte weisen auf Aspekte hin, die im Hinblick auf die Verwendung von Werkzeugen wie ChatGPT berücksichtigt werden sollten.

Was ist ChatGPT?

ChatGPT ist ein textbasierter Chatbot. Die Abkürzung GPT steht für „Generative Pre-trained Transformer“. Es handelt sich um ein künstliches neuronales Netz, das darauf trainiert ist, möglichst natürliche Sprache zu produzieren, um mit Nutzer*innen über textbasierte Nachrichten zu kommunizieren.

Anlass für die Lehrentwicklung: Zeitgemäße Kompetenzziele

KI-Werkzeuge werden Berufsbilder verändern oder haben dies bereits. Daher ist es notwendig, über zeitgemäße Kompetenzziele und adäquate Prüfungsformate nachzudenken. Für die einzelnen Studiengänge ist zu diskutieren, welche Qualifikationen die Absolvent*innen von morgen für die Berufstätigkeit benötigen, wie Curricula weiterentwickelt werden müssen, welche Lernergebnisse im Rahmen von Modulen zu erreichen sind und welche Methoden trotz und/oder mit Hilfe von KI-Anwendungen zu diesen Ergebnissen führen. Die Leistungsfeststellung muss auf eine Art erfolgen, dass die eigene Leistung sichtbar wird. Hier müssen ggf. Prüfungsformate sowie Aufgabenstellungen durch die verantwortlichen Lehrenden angepasst werden. Ideen hierzu werden in unterschiedlichen Kontexten diskutiert (s. u. Quellenangaben).

Selbst denken macht schlau

Hochschulbildung zielt darauf ab, den Erwerb forschungsbasierten Wissens, berufspraktischer Kompetenzen sowie gesellschaftlichen Verantwortungsbewusstseins und Reflexionsfähigkeit zu ermöglichen. Das Verwenden von KI-basierten Sprachmodellanwendungen kann das Lernen unterstützen, z. B. beim Ideen-Brainstorming oder beim Leseverstehen. Solche Anwendungen können aber auch dazu verführen, sich das Leben besonders leicht zu machen. Dies kann dazu führen, die Chance auf den Erwerb eigener Kompetenzen zu vergeben und die Hochschulbildungsziele nicht zu erreichen. Dadurch besteht die Gefahr, als Absolvent*in dem im Curriculum vorgesehenen Qualifikationsprofil nicht zu entsprechen und in der späteren Berufstätigkeit nicht kompetent handeln zu können.

Die kompetente Nutzung vergleichbarer Anwendungen ist zweifellos eine wichtige Fähigkeit für das Berufsleben. Um die Ausgaben solcher Werkzeuge beurteilen zu können, ist aber eine fundierte Fachkompetenz erforderlich. Die Gelegenheit, sich diese Kompetenz im Studium anzueignen, sollte man sich daher nicht entgehen lassen.

Kritische Nutzung

KI-Anwendungen wie ChatGPT sind Sprachmodelle und (noch) keine Expertensysteme. Sie produzieren zum Teil erfundene oder aus anderen Quellen generierte Ergebnisse. Genauso wie beim Umgang mit Literatur und mit Ergebnissen aus Internetsuchmaschinen muss die Qualität der Resultate und der Quellen überprüft werden. Die Bewertung der ausgegebenen Informationen ist vor allem dann schwierig, wenn etwa im Vergleich zu klassischen Suchmaschinen nur ein Ergebnis generiert wird und die Quelle des Ergebnisses intransparent bleibt.

Quellenkritik ist also im Umgang mit diesen Anwendungen besonders wichtig und eine korrekte wissenschaftliche Recherche unabdingbar. Nur wer zuvor Wissen und Kompetenzen erworben hat, kann mit diesen Systemen adäquat umgehen und deren Ergebnisse korrekt einschätzen.

Sich bewusst sein

In vielen entstehenden Texten werden aufgrund der Datengrundlage, anhand derer die Sprachmodelle trainiert wurden, bestimmte gesellschaftliche Normen und Sichtweisen (Bias) reproduziert bzw. verdichtet. Ergebnisse sollten entsprechend betrachtet und bei der Verwendung hinterfragt werden.

Anwendungen wie ChatGPT benötigen große Mengen an Energie. Auch sind die Arbeitsbedingungen von Mitarbeiter*innen, die das Modell mit Daten versorgen, teilweise fraglich. Daher ist ein bewusster Umgang mit derartigen KI-Anwendungen unbedingt nötig.

Die Nutzung von ChatGPT und vergleichbaren Tools braucht ein Konto, für das persönliche Daten inklusive Telefonnummer eingegeben werden müssen.

Die Verwendung von ChatGPT ist ein unbezahlter Beitrag zur Weiterentwicklung eines Werkzeuges, das kommerziell genutzt wird.

Vorsicht bei der Eingabe

Das Eingeben von vertraulichen sowie personenbezogenen Daten (z. B. Interview- oder Unternehmensdaten) verstößt gegen geltendes Recht, insbesondere die Datenschutzgrundverordnung. ChatGPT gibt kein transparentes Datenschutzsystem an und Dritte haben möglicherweise Zugriff auf die Daten. Generell gilt bei der Verwendung von personenbezogenen Daten: Bei der Nutzung von KI-Anwendungen oder allgemeinen digitalen Diensten ist deren Umgang mit Datenschutz stets genau zu prüfen und muss den europäischen und nationalen Bestimmungen vollumfassend entsprechen.

Auch kann die Eingabe von umfangreichen urheberrechtlich geschützten Texten beim Prompten eine Urheberrechtsverletzung (durch Vervielfältigung) darstellen.

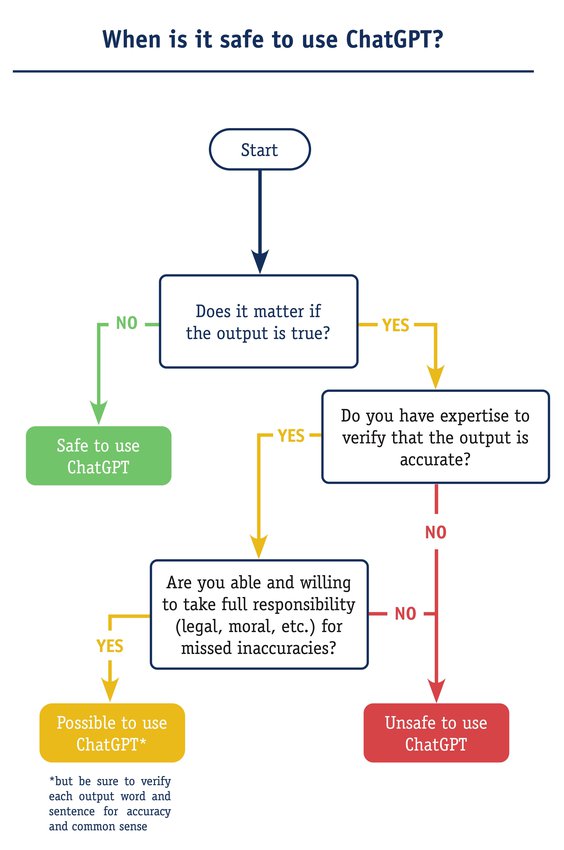

Sicherer Umgang mit ChatGPT

https://unesdoc.unesco.org/ark:/48223/pf0000385146.

Transparenz herstellen

Die Frage der Urheberschaft bei KI-generierten Textprodukten ist komplex. Ein generatives Sprachmodell wie z. B. ChatGPT kann laut aktueller Rechtslage kein Urheber sein. Nutzer*innen können Urheber*innen von KI-unterstützt erstellten Texten sein, sofern sie eine wesentliche geistige gestalterische Eigenleistung am Text erbracht haben.

An der Fachhochschule Kiel werden KI-Anwendungen wie ChatGPT als Hilfsmittel gewertet. Die Lehrenden entscheiden damit über die Zulässigkeit des Einsatzes. Je nach Aufgabenstellung sind Studierende daher verpflichtet anzugeben, wo und in welcher Art und Weise sie das generative Sprachmodell genutzt haben. Eine unerlaubte Nutzung solcher Hilfsmittel im Rahmen von Prüfungen fällt unter Täuschung (siehe § 12 der Prüfungsverfahrensordnung).

Stand: November 2023

Quellen

Die Hinweise basieren z. T. auf: David, Lisa (2023). Umgang mit KI-Anwendungen, wie ChatGPT: Empfehlungen. FH St. Pölten. https://www.fhstp.ac.at/de/mediathek/pdfs/infoblaetter/leitplankenchatgpt_studierendelehrende.pdf.

Fleischmann, Andreas (2023). ChatGPT in der Hochschullehre. Wie künstliche Intelligenz uns unterstützen und herausfordern wird. Neues Handbuch Hochschullehre, 110/2023. [zugänglich aus dem FH-Netz bzw. über VPN]

Salden, Peter & Leschke, Jonas (2023). Didaktische und rechtliche Perspektiven auf KI-gestütztes Schreiben in der Hochschulbildung. Handreichung des Zentrums für Wissenschaftsdidaktik an der Ruhr-Universität Bochum. https://hss-opus.ub.ruhr-uni-bochum.de/opus4/frontdoor/deliver/index/docId/9734/file/2023_03_06_Didaktik_ Recht_KI_Hochschulbildung.pdf.

Weitere Informationen (Auswahl)

Virtuelles Kompetenzzentrum: Künstliche Intelligenz und wissenschaftliches Arbeiten

ChatGPT im Hochschulkontext – eine kommentierte Linksammlung, Hochschulforum Digitalisierung. https://hochschulforumdigitalisierung.de/de/blog/chatgpt-im-hochschulkontext-%E2%80%93-eine-kommentierte-linksammlung.

ChatGPT im Studium. Potenziale ausschöpfen, Integrität wahren. Handreichung. Universität Mannheim. https://www.uni-mannheim.de/media/Einrichtungen/Koordinationsstelle_Studieninformationen/Dokumente/Erstsemester/ChatGPT_Handreichung_Studierende_UMA_Stand_Mai_2023.pdf.

Positionspapier der Ludwig-Maximilians-Universität München (engl.). https://edarxiv.org/5er8f/.

KI in der Hochschullehre. Reihe der dghd – Deutsche Gesellschaft für Hochschuldidaktik. https://www.youtube.com/@dghd_info.

Stellungnahme des Präsidiums der Deutschen Forschungsgemeinschaft zum Einfluss generativer Modelle zur Text- und Bilderstellung auf die Wissenschaften und das Förderhandeln der DFG. https://www.dfg.de/foerderung/info_wissenschaft/2023/info_wissenschaft_23_72/index.html.

Merkmale guter Prompts für textgenerierende KI-Tools

Was ist ein Prompt?

Anfragen, die man an ein System der künstlichen Intelligenz stellt, oder Anweisungen, die man solch einem Tool erteilt, werden Prompts genannt. Gute Prompts zu formulieren ist wichtig, um nützliche Ergebnisse zu erhalten. Folgende Eigenschaften zeichnen einen guten Prompt aus:

Zielorientierung und Präzision |

Der Prompt sollte genau formulieren, was erfragt oder erreicht werden soll, ohne mehrdeutig zu sein. Dies betrifft auch die Komplexität und den Detailgrad: Geben Sie bspw. an, ob Sie einen Überblick oder eine detaillierte Analyse wollen oder welchen Zeitraum Sie betrachten wollen. Je klarer und spezifischer die Frage oder Anweisung ist, desto präziser wird das Ergebnis. |

Kontext |

Wenn Ihr Anliegen spezifisches Hintergrundwissen erfordert oder ein spezifischer Anwendungskontext berücksichtigt werden soll, integrieren Sie relevante Informationen in Ihren Prompt. |

Zweck, Detailgrad, Stil |

Der Prompt sollte auf das gewünschte Ergebnis ausgerichtet sein. Was genau braucht man als Ergebnis? Wozu will man dies verwenden? Welchen Umfang soll die Antwort haben? Wen möchte man adressieren? Welche Kenntnisse, Erfahrungen und Erwartungen hat die Zielgruppe? Solche Überlegungen sollten in die Formulierung einfließen. Dies beinhaltet auch die Verwendung der passenden Sprache (z. B. formal oder umgangssprachlich) und des passenden Tonfalls (z. B. humorvoll, nüchtern). |

Schlüsselwörter |

Wenn es spezifische Begriffe oder Konzepte gibt, die im Text vorkommen sollen, integrieren Sie diese Schlüsselwörter in Ihren Prompt. Dies hilft der KI, den Fokus besser zu verstehen. |

Strukturierung |

Ein strukturierter Aufbau des Prompts kann dazu beitragen, dass das System die Anfrage besser verarbeiten kann und dass auch die Antwort den Bedarfen besser entspricht. Dies kann z. B. durch Aufzählungen, klare Fragestellungen oder die Einteilung in Abschnitte erreicht werden. |

Erläuterungen oder Beispiele |

Wenn Sie möchten, dass die KI schwierige Konzepte erläutert oder Beispiele in ihre Antwort einbindet, um z. B. komplexe Sachverhalte zu veranschaulichen, fordern Sie diese explizit an. |

Datenschutz und Urheberrecht |

Achten Sie darauf, keine vertraulichen oder urheberrechtlich geschützten Daten in Ihren Prompts zu verwenden, also z. B. keine personenbezogenen Daten, fremde Texte oder vertrauliche Unternehmensdaten einzugeben. |

Experimentieren Sie |

Nicht jeder Prompt liefert beim ersten Versuch das gewünschte Ergebnis. Scheuen Sie sich nicht, mit unterschiedlichen Formulierungen, Detailgraden und Stilen zu experimentieren, um herauszufinden, was am besten funktioniert. |

Nutzen Sie iterative Abfragen |

Wenn Sie eine komplexe Information benötigen, starten Sie mit einem breiten Überblick und nutzen Sie dann weitere Prompts, um schrittweise ins Detail zu gehen. |

Achtung: Bias!

Bitte beachten Sie, dass alle Ausgaben bzw. Antworten des Systems von Ihnen geprüft und bewertet werden müssen, bspw. in Bezug auf ihren Wahrheitsgehalt und zugrunde gelegte gesellschaftliche Normen und Sichtweisen (Bias).

Textgenerierende KI-Werkzeuge wie ChatGPT sind keine Suchmaschinen

Noch ein Hinweis: Textgenerierende KI-Werkzeuge wie ChatGPT sind keine Suchmaschinen.

Was ist der Unterschied?

Suchmaschinen wie z. B. Google bieten eine Schnittstelle, in der Nutzer*innen Wörter, Sätze oder Satzteile eingeben können, um eine Liste von Webseiten, Dokumenten oder anderen Ressourcen zu finden, die die angegebenen Begriffe enthalten oder damit in Zusammenhang stehen. Die Aktualität und Vielfalt der bereitgestellten Informationen sind in diesem Fall abhängig von der stetigen Aktualisierung der Suchmaschinenindizes und der Verfügbarkeit der Inhalte im Internet.

Textgenerierende KI-Werkzeuge wie ChatGPT dagegen interagieren mit Nutzer*innen in einem dialogbasierten Stil. Sie liefern Antworten direkt im Textformat. Die Antworten basieren dabei nicht auf einem Denkprozess im menschlichen Sinne. Stattdessen wird maschinelles Lernen dazu verwendet, Wahrscheinlichkeiten für das geeignetste nächste Wort zu berechnen und dieses dann als Teil der Antwort auszugeben. Solche Systeme liefern Antworten auf der Basis einer enorm großen Datenmenge, die während der Trainingsphase verwendet wurden. Entsprechend basieren die Antworten auf den Informationen, die bis zum letzten Trainingsupdate verfügbar waren. Das System berücksichtigt also nicht bzw. nicht zwingend die aktuellsten im Internet verfügbaren Angaben und die Antworten sind auf statistischen Wahrscheinlichkeiten beruhende Angaben, keine Expertenaussagen.

Stand: März 2024